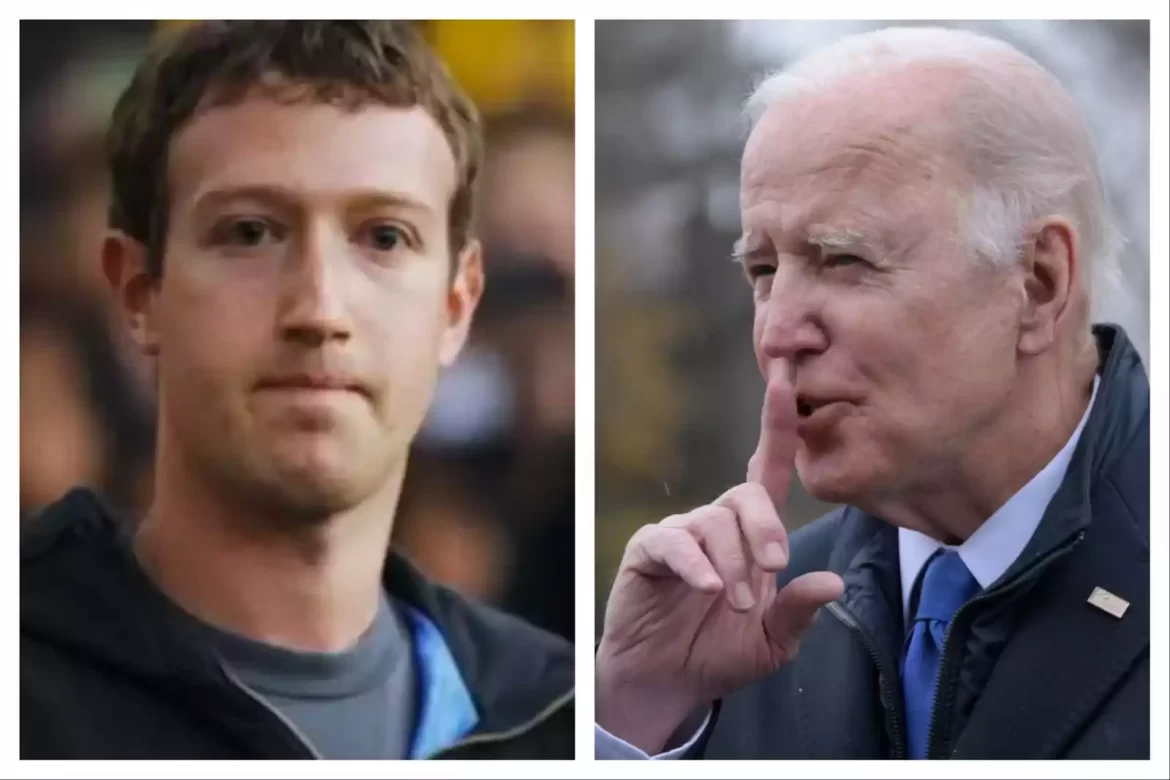

Meta, dirigida por Mark Zuckerberg, ha decidido poner fin a su programa de verificación de hechos y eliminar las restricciones de contenido en sus plataformas. Según la compañía, esta medida busca «restaurar la libertad de expresión» tras años de críticas por prácticas consideradas excesivas en la moderación de publicaciones.

El anuncio fue realizado poco después de una entrevista de Zuckerberg en el podcast de Joe Rogan, donde reveló detalles de las presiones que su equipo enfrentó por parte de la administración de Joe Biden, especialmente durante el lanzamiento de las vacunas contra el COVID-19.

Presiones políticas y censura en Meta

Zuckerberg confesó que miembros del gobierno de Biden exigieron la eliminación de contenido que mencionaba efectos secundarios de las vacunas, incluso cuando estas afirmaciones eran verídicas.

“Nos exigieron eliminar cualquier cosa que mencionara efectos secundarios de las vacunas, incluso cuando esas afirmaciones eran claramente verdaderas”, señaló el CEO de Meta.

La situación se tensó aún más cuando el presidente Biden acusó a las plataformas de Meta de «estar matando gente» al permitir la difusión de desinformación sobre las vacunas. Esta declaración dio lugar a investigaciones y acciones legales contra la empresa por parte de diversas agencias gubernamentales.

El dilema de la moderación de contenidos

Zuckerberg justificó la decisión de Meta de abandonar la verificación de hechos argumentando que la moderación había llegado a un punto insostenible:

“No vamos a eliminar cosas que son verdad. Eso es ridículo”, afirmó.

El CEO también destacó los desafíos de equilibrar la libertad de expresión con las presiones gubernamentales, especialmente en una plataforma global como Facebook o Instagram.

¿Un cambio hacia la libertad de expresión?

La decisión de Meta representa un cambio de rumbo en su estrategia de moderación. Según la compañía, relajar estas políticas busca restaurar la confianza de los usuarios y demostrar su compromiso con la libertad de expresión en el entorno digital.

Sin embargo, la eliminación de herramientas de verificación de hechos plantea interrogantes sobre el impacto que esto podría tener en la calidad de la información compartida en sus plataformas.

Posibles consecuencias de la nueva política de Meta

- Aumento de la desinformación: Sin verificación de hechos, las plataformas de Meta podrían convertirse en un terreno fértil para la propagación de noticias falsas.

- Reducción de la presión gubernamental: Meta podría evitar futuras investigaciones y demandas al desmarcarse de una postura activa en la moderación de contenido.

- Competencia en el sector: Este movimiento podría influir en otras plataformas tecnológicas, forzándolas a reconsiderar sus políticas de moderación de contenido.

- Confianza del usuario: Aunque algunos usuarios podrían celebrar la medida como un triunfo para la libertad de expresión, otros podrían cuestionar la fiabilidad de la información en Facebook e Instagram.

Un precedente en el entorno digital

El paso de Meta hacia una moderación más relajada abre un nuevo capítulo en el debate sobre el equilibrio entre la libertad de expresión y la regulación del contenido en línea. Este movimiento podría redefinir cómo las plataformas digitales manejan la información, especialmente en contextos políticos y sociales sensibles.

El desafío ahora es evaluar si esta decisión logrará fortalecer la confianza de los usuarios en el ecosistema digital o si, por el contrario, exacerbará los problemas asociados con la desinformación y la manipulación en internet.